De opkomst van neurotechnologie die onze mentale toestanden wellicht kan uitlezen en beïnvloeden spreekt tot de verbeelding. Technologiebedrijven ontwikkelen apparaten voor consumenten thuis, op de werkvloer of in het klaslokaal. Ethici en juridisch specialisten waarschuwen dat cognitieve vrijheid en mentale integriteit onder druk komen te staan als buitenstaanders met neurotechnologie toegang krijgen tot onze mentale toestanden.

In deze scan geeft het Rathenau Instituut een overzicht van neurotechnologie. We beschrijven beoogde toepassingen, kansen en risico's voor publieke waarden op korte en lange termijn en beleidsinstrumenten voor het beschermen en realiseren van deze waarden. De scan sluit af met handelingsopties voor beleidsmakers. Deze Rathenau Scan is geschreven op verzoek van het ministerie van Binnenlandse Zaken en Koninkrijksrelaties.

Wat is neurotechnologie?

Onze hersenen zijn een complex orgaan waar verschillende mentale toestanden zoals concentratie, aandacht, cognitieve vaardigheden, gedachten, herinneringen, emoties en dromen hun oorsprong vinden. Er wordt al decennia flink geïnvesteerd in onderzoek om de processen in het brein die deze mentale toestanden tot stand brengen beter te begrijpen.

Aanleiding voor een Rathenau Scan over neurotechnologie

Het Rathenau Instituut ziet drie belangrijke redenen om juist nu goed in beeld te brengen hoe ver neurotechnologie is, en welke mogelijke invloed de technologie kan krijgen op de samenleving. Ten eerste begeven grote technologiebedrijven zich in toenemende mate op het gebied van neurotechnologie waardoor het aanbod van apparaten die werken met neurotechnologie voor consumenten groeit.

Ten tweede zien we technologische ontwikkelingen die het gebruik van neurotechnologie buiten het medische domein laagdrempeliger zullen maken. Tot slot is er een internationale ethisch-juridische discussie gaande over de noodzaak van het uitbreiden van bestaande mensenrechtenkaders met specifieke ‘neurorechten’.

Hoe werkt neurotechnologie?

Om te begrijpen hoe neurotechnologie werkt, is het nuttig verschillende processen die van belang zijn bij de technologie te onderscheiden.

Meten: In de hersenen bevindt zich een groot aantal neuronen (zenuwcellen) die elektrische signalen afvuren als ze actief zijn. Een actief hersengebied verbruikt ook extra zuurstof. Dit soort fysiologische activiteit kan worden waargenomen en met een meetsysteem omgezet worden in digitale data. Verschillende technieken, zoals EEG, ECoG of fMRI, meten verschillende typen fysiologische activiteit. Neurodata zijn dus een digitale representatie van fysiologische activiteit – zuurstofgebruik en elektrische activiteit – in de hersenen.

Analyseren: Neurodata worden door een professional, een consument, en/of een computerprogramma geïnterpreteerd om inzichten af te leiden over de mentale toestanden van een individu. In consumententoepassingen wordt vaak een AI-systeem gebruikt om patronen te zoeken en te presenteren in neurodata. De analyse van neurodata is geslaagd wanneer er nuttige inzichten worden verkregen over de mentale toestanden. Onderzoekers kunnen ook neurodata van verschillende individuen samenvoegen en eventueel combineren met andere typen data om te leren over hoe emoties, voorkeuren of gedachten werken op groepsniveau.

Toepassen: Inzichten over de mentale toestanden van een individu of groep kunnen op verschillende manieren gebruikt worden. De kennis die neurotechnologie oplevert over onze mentale toestanden kan direct worden gebruikt (neurofeedback). De technologie kan ook worden ingezet voor neuromodulatie, in dit geval beïnvloedt neurotechnologie de hersenactiviteiten. Of neurotechnologie wordt gebruikt voor het aansturen van een computersysteem.

Toepassingen van neurotechnologie

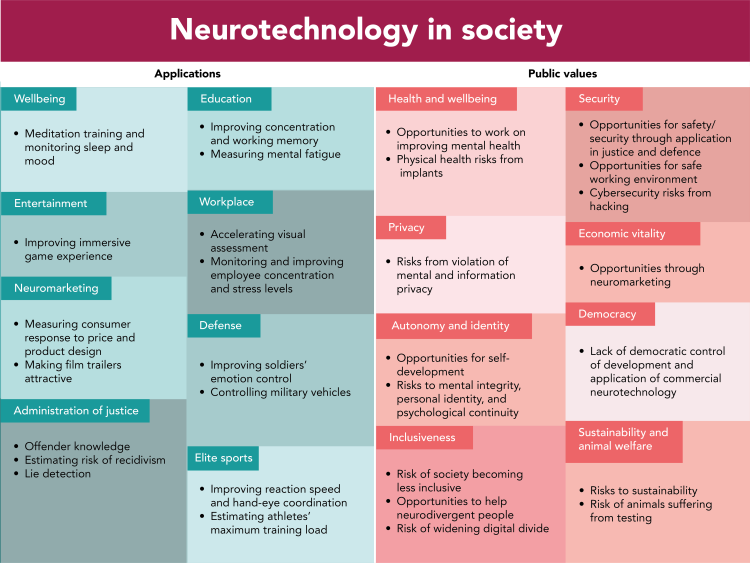

De grootste groei van het gebruik van neurotechnologie op korte termijn zijn droge EEG-meetsystemen die gebruik maken van AI-systemen voor de analyse en ingebouwd worden in bestaande hardware, zoals helmen, hoofdbanden, AR/VR-brillen of oordopjes. Gebruikers kunnen deze nu al aanschaffen om hun cognitieve vermogens, mentale gezondheid of game-ervaring te verbeteren.

Inzichten over iemands mentale toestanden zoals aandacht en voorkeur worden ingezet om marketing te verbeteren. In experimenteel onderzoek wordt er gekeken of neurodata inzicht kunnen geven over waar iemand een herinnering aan heeft. Deze toepassing kan bruikbaar zijn in de rechtspraak. In experimenten is laten zien dat neurofeedback kan bijdragen aan leerprestaties, de verbetering van concentratie op de werkvloer, en de verbetering van de prestaties van topsporters en soldaten binnen specifieke omstandigheden. Hoe deze resultaten standhouden in de wereld buiten het laboratorium moet nog beter worden onderzocht.

Neuromodulatie wordt nog niet toegepast buiten het medische domein. Het aansturen van apparaten met behulp van EEG wordt op kleine schaal toegepast in gaming en onderzocht voor verschillende defensietoepassingen, zoals het besturen van een militair voertuig.

Kansen en risico’s voor publieke waarden

We signaleren dat verschillende elementen van neurotechnologie in het niet-medische domein kansen en risico’s voor publieke waarden met zich meebrengen. Voor het individu kan meer inzicht in mentale toestanden zoals concentratievermogen, positieve gevolgen hebben voor de mentale gezondheid. Daarnaast kan neurotechnologie bijdragen aan zelfontplooiing, bijvoorbeeld door het leervermogen te verbeteren tijdens het volgen van onderwijs. Mogelijk kan met inzichten uit neurodata marketing voor commerciële of publieke doeleinden worden verbeterd met als gevolg economische vitaliteit en welvaart. Tegelijkertijd constateren we dat claims over de mogelijkheden van neurotechnologie op dit moment niet altijd wetenschappelijk gegrond zijn.

Op het niveau van de samenleving zou neurotechnologie veiligheid kunnen verbeteren door mensen in (gevaarlijke) beroepen te monitoren en alertheid en concentratie te meten en door het versterken van defensie.

De keerzijde van de genoemde kansen voor het individu zijn risico’s voor informationele en mentale privacy. Een meetsysteem kan worden gehackt en worden gebruikt om een poging te doen om persoonlijk informatie te verkrijgen. In een experiment is bewezen dat het mogelijk is om met behulp van het laten zien van foto’s met cijfers en het analyseren van neurodata een goede inschatting te maken over iemands pincode.

Met risico’s voor mentale privacy bedoelen we het privé houden van mentale toestanden zoals een gedachten die je niet vrijwillig wil prijsgeven. Er zijn tot de verbeelding sprekende experimenten gedaan waarbij waargenomen beelden of geluiden door proefpersonen volledig vanuit neurodata konden worden gereconstrueerd. Echter zijn de mogelijkheden tot gedachtenlezen op dit moment beperkt en waarschijnlijk ook in de toekomst is onze persoonlijke gedachtewereld niet zomaar te ontsluiten. De menselijke ervaring en gedachten daarover is volgens experts niet te reduceren tot fysiologische activiteiten in de hersenen en de daaruit afgeleide neurodata. Deze nuances zijn belangrijk om risico’s van neurotechnologie voor mentale privacy op waarde te kunnen schatten.

Toch kan neurotechnologie wel degelijk risico’s opleveren wanneer neurodata wordt gebruikt tegen het belang in van een gebruiker of publieke belangen. Wat wordt afgeleid uit neurodata hoeft niet volledig in overeenstemming te zijn met daadwerkelijke mentale toestanden om schadelijke gevolgen te hebben. Werken met verkeerde interpretaties kan in de toekomst leiden tot een verkeerde veroordeling in een rechtszaal of het verkeerd meten van alertheid op de werkvloer.

Ook zijn er risico’s die gepaard gaan met het gebruik van AI-systemen in neurotechnologie. Een bias in de trainingsdata kan bepaalde groepen mensen benadelen omdat de technologie onvoldoende of niet voor hen werkt. De inzet van AI-systemen kan ook ten koste gaan van autonomie. Wanneer een AI-systeem direct anticipeert op patronen in neurodata is het onduidelijk wie er verantwoordelijk is voor het maken van een beslissing.

Een brede implementatie van neurotechnologie leidt mogelijk tot kansen voor meer inclusiviteit wanneer neurodivergente personen worden geholpen om beter hun weg te vinden in onze samenleving. Tegelijkertijd bestaat het risico ook dat verschillen tussen mensen minder geaccepteerd worden omdat deze behandeld kunnen worden. Wat nu als angstigheid kan worden gezien, valt mogelijk te worden gecorrigeerd in de toekomst. Dit kan helpen voor individuen en tegelijk leiden tot meer stigmatisering van klachten.

Risico’s op korte en lange termijn

De belangrijkste kansen en risico’s van neurotechnologie lijken grofweg op te delen in twee groepen. Consumenten kunnen nu al hun voordeel doen met draagbare, niet-invasieve beeldvormende neurotechnologie, zoals EEG. De risico’s die deze technologie met zich meebrengt ligt in het verlengde van andere dataprivacy discussies, maar gaat een stap verder doordat deze technologie letterlijk en figuurlijk dicht op de huid zit.

Andere neurotechnologieën, zoals invasieve hersenimplantaten, apparaten die de hersenen direct beïnvloeden (moduleren) en niet-draagbare beeldvormende neurotechnologie, bieden meer mogelijkheden om mentale toestanden in beeld te brengen of te beïnvloeden, maar zijn nog sterk in ontwikkeling, vaak minder gebruikersvriendelijk en moeten aan strenge medische richtlijnen voldoen. De brede maatschappelijke risico’s van deze neurotechnologieën zijn daarmee van een langere termijn en hogere onzekerheid. Wel zijn ze van een veel ingrijpender aard.

Beleidsanalyse

Gezien de mogelijke kansen en risico’s is het belangrijk met beleid en regulering te anticiperen op de maatschappelijke effecten van neurotechnologie.

Onduidelijkheid van privacywetgeving

Voor de korte termijn gelden risico’s die te maken hebben met het verzamelen, opslaan, verwerken en analyseren van neurodata. Hierop zijn met name de Europese AVG en de AI-verordeningen van toepassing. Het is waarschijnlijk dat neurodata en de informatie die eruit afgeleid kan worden over persoonlijke voorkeuren, buiten bepaalde specifieke contexten zoals gezondheid of politiek, onvoldoende beschermd worden door deze wetten. Wanneer de neurodata in de AVG onder de categorie gezondheidsgegevens of bijzondere persoonsgegevens vallen en de privacy van betrokkenen dus extra beschermd wordt, is onduidelijk. Niet-pathologische, emotionele informatie en affectieve mentale toestanden vallen mogelijk buiten deze bescherming.

Daarnaast brengen neurodata inherente uitdagingen mee ten aanzien van de basisvereisten van de AVG: transparantie en geïnformeerde toestemming, proportionaliteit, dataminimalisatie, doelbinding en juistheid. Als de neurodata vervolgens geanalyseerd worden, kan de AI-verordening een rol spelen. Dit geldt echter alleen voor hele specifieke toepassingen, onder voorwaarden die vaag geformuleerd zijn, en waarbij veel uitzonderingen en een regime van zelfbeoordeling gelden. Veel gaat afhangen van de implementatie in standaarden en richtlijnen.

Neurorechten

Op bepaalde punten lijkt het recht tekort te schieten en worden risico’s onvoldoende gemitigeerd, vooral wanneer neurotechnologie op grote schaal wordt gebruikt. Het gaat om risico’s voor informationele privacy (het beschermen van persoonlijke data) en mentale privacy (het privé houden van alle genoemde mentale toestanden), autonomie en identiteit, fysieke veiligheid en mentale gezondheid, democratie en inclusiviteit.

De huidige neurorechtendiscussie gaat met name over de vraag of alle genoemde mentale toestanden van individuen in het licht van opkomende neurotechnologie voldoende beschermd worden door de huidige nationale, Europese en internationale mensenrechtenkaders. Hierover bestaat nog geen consensus. Ten eerste staat ter discussie of mensenrechtenkaders voldoende kunnen meebewegen met nieuwe omstandigheden die ontwikkelingen van neurotechnologie mogelijk met zich meebrengen, of dat er aanpassingen nodig zijn. Ten tweede bestaat er verschil van inzicht over of er nu al gereageerd moet worden op ontwikkelingen van neurotechnologie die zich mogelijk pas op lange termijn (of zelfs nooit) zullen voordoen (zoals bijvoorbeeld het heimelijk lezen van gedachten). Ten derde is een open vraag wat zwaarder weegt: moeten mensen vrij zijn hun mentale toestanden te verbeteren met behulp van neurotechnologie of dienen ze beschermd te worden tegen inmenging in mentale toestanden van buitenaf?

Het Rathenau Instituut concludeert dat deze kansen en risico's op korte termijn samenhangen met het op grote schaal op de markt komen van draagbare neurotechnologie die eenvoudig is in het gebruik voor niet-medisch opgeleide personen. Het grootschalig verzamelen en verwerken van neurodata gaat met risico's gepaard waarbij het onduidelijk is of de huidige Nederlandse, Europese en internationale regelgeving voldoende bescherming biedt. Als neurotechnologieën op de lange termijn een grote ontwikkeling doormaken, wordt het wellicht mogelijk om mentale toestanden met meer nauwkeurigheid af te lezen, te beïnvloeden en te manipuleren. In dat geval komen publieke waarden die samenhangen met fundamentele aspecten van het mens-zijn, zoals autonomie en identiteit, onder druk te staan.

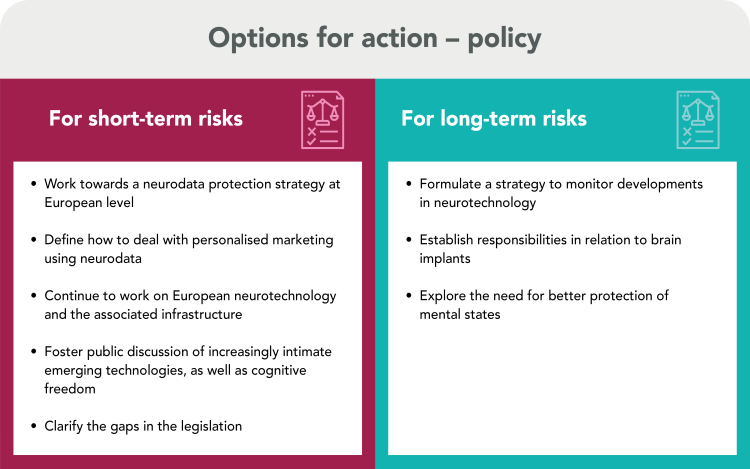

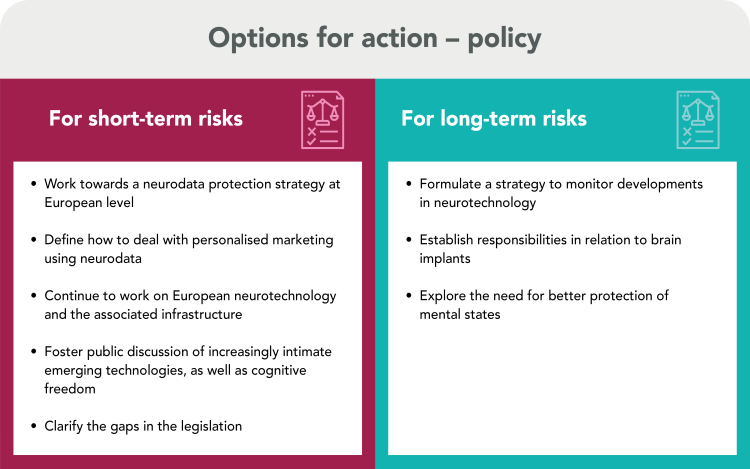

We concluderen dat verschillende beleidsinstrumenten tot op zekere hoogte bescherming bieden tegen risico’s voor publieke waarden van neurotechnologie, maar niet volledig. Er zijn verschillende handelingsopties voor het beschermen en realiseren van publieke waarden in relatie tot de korte termijn impact van draagbare, non-invasieve technologie, en de onzekere lange termijn impact van andere neurotechnologieën. Deze worden samengevat in de figuur hieronder.