Scrollend naar de stembus

De rol van aanbevelingsalgoritmen bij inmenging in verkiezingen

Rapport

Downloads

De Tweede Kamercommissie voor Digitale zaken vroeg ons te onderzoeken welke rol de aanbevelingsalgoritmen van grote socialmediaplatformen kunnen spelen bij inmenging in verkiezingen. Uit ons rapport blijkt dat kwaadwillenden handig gebruik kunnen maken van de algoritmen en dat de maatregelen om inmenging aan te pakken slechts ten dele voldoen. We doen voorstellen die het risico op inmenging verminderen.

Op verzoek van de Tweede Kamercommissie voor Digitale Zaken deed het Rathenau Instituut onderzoek naar welke rol aanbevelingsalgoritmen van grote socialmediaplatformen kunnen spelen bij inmenging in verkiezingen.

We analyseerden academische literatuur, juridische literatuur en grijze literatuur zoals journalistieke bronnen, rapporten en verslagen van rechtszaken. Daarnaast hebben we vertegenwoordigers van een aantal platformen (schriftelijk) geïnterviewd. Ook spraken we beleidsmedewerkers die zich bezighouden met verkiezingen, platformbeleid en inmenging. Verder interviewden en consulteerden we tijdens een expertsessie deskundigen uit onder meer de vakgebieden politieke communicatie, informatica, rechten, en mediawetenschappen.

Inmenging

Inmenging is beïnvloeding door of namens een buitenlandse statelijke actor die strijdig is met de soevereiniteit, waarden of belangen van het beïnvloede land. De handelingen zijn dwingend, heimelijk, misleidend of corrumperend. Inmenging kan mensen tegen elkaar opzetten, de stemuitslag beïnvloeden en twijfel zaaien over het democratisch proces.

Inmenging via socialmediaplatformen

We richtten ons op een relatief nieuwe vorm die steeds laagdrempeliger en geavanceerder wordt: inmenging via de aanbevelingsalgoritmen van socialmediaplatformen.

Onder inmenging via socialmediaplatformen verstaan we de georkestreerde inzet van meerdere accounts, pagina's of platformen door buitenlandse statelijke actoren en/of hun vertegenwoordigers om de zichtbaarheid van bepaalde inhoud te vergroten of te verkleinen. Dat doen ze door in te spelen op de aanbevelingsalgoritmen van socialmediaplatformen. Betrokken actoren proberen daarbij de ontvanger van de inhoud bewust te misleiden over de identiteit, motieven, acties of connecties van de betrokken actoren en/of de populariteit van de inhoud. Doel is om uiteindelijk de publieke opinie of verkiezingen te beïnvloeden.

Aanbevelingsalgoritmen

Aanbevelingsalgoritmen zijn een verzameling aan systemen die inhoud sorteren en rangschikken op basis van data, met als doel om mogelijk interessante inhoud aan te raden aan gebruikers. Aanbevelingsalgoritmen zijn een antwoord op het probleem van informatieoverload op het internet: uit al de beschikbare inhoud wordt geprobeerd jou iets te laten zien wat je leuk, interessant of anderszins relevant vindt.

Platformen en hun ontwerpers hebben een voorkeur voor inhoud die zorgt dat gebruikers lang op het platform blijven en het platform vaak bezoeken. Sinds 2016 stapten veel grote platformen over op het rangschikken van inhoud op basis van het verwachte engagement (likes, reacties, tijd besteed, etc.). Want hoe meer engagement, hoe hoger de advertentie-inkomsten.

Het gevolg van aanbevelingsalgoritmen gebaseerd op engagement is dat bepaalde inhoud meer zichtbaar gemaakt kan worden (geamplificeerd, versterkt).

Het inmengingsinstrumentarium

Opruiende of manipulatieve inhoud die wordt verspreid om kiezers te beïnvloeden, is gemaakt om engagement van mensen op te roepen, zoals liken, doorsturen of een video opnieuw kijken. Kwaadwillende (buitenlandse) actoren kunnen gebruik maken van de mogelijkheden die op engagement gebaseerde aanbevelingsalgoritmen bieden om een groot bereik te krijgen.

Dit onderzoek laat zien dat het instrumentarium voor inmengingsactiviteiten op socialmediaplatformen groot en divers is, en dat de mogelijkheden voor inmenging steeds laagdrempeliger en geavanceerder worden. Socialmediaplatformen veranderen continu, waardoor het instrumentarium ook verandert. Nu socialmediaplatformen steeds meer gebruikmaken van aanbevelingsalgoritmen, spelen kwaadwillende actoren hierop in. Ze gebruiken bijvoorbeeld hyperactieve accounts en coördineren hun berichten en hashtags.

Bestaande maatregelen voldoen slechts deels

De wetgever heeft instrumenten ontwikkeld om verschillende aspecten van inmenging aan te pakken. Voorbeelden zijn het vergroten van de verantwoordingsplicht van platformen, het ingrijpen op het ontwerp en het vergroten van transparantie over circulerende inhoud. En platformen hebben richtlijnen, community guidelines, over welke inhoud en activiteiten op hun platforms verboden zijn.

Experts signaleren echter dat juist eenvoudige maatregelen, zoals het verwijderen van nepaccounts, niet door platformen genomen lijken te worden. Aanbevelingsalgoritmen zouden ook kunnen worden aangepast zodat ze minder geschikt worden voor inmengingsactiviteiten.

Bovendien is het voor onafhankelijke onderzoekers en voor journalisten moeilijk om grip te krijgen op de aard, omvang en effectiviteit van inmenging via socialmediaplatformen. Het onderzoek is namelijk afhankelijk van medewerking van de platformbedrijven. Welke inhoud er relatief meer rondgaat en wie dat bereikt, is daardoor onduidelijk. Dat maakt het moeilijk om te beoordelen of de maatregelen van platformen effectief zijn. Recente voorbeelden in Nederland en Europa maken duidelijk dat aanbevelingsalgoritmen een scala aan mogelijkheden voor inmengingsactiviteiten bieden en daarmee een risico vormen voor het online politieke debat.

Drie handelingsperspectieven om risico op inmenging te verkleinen

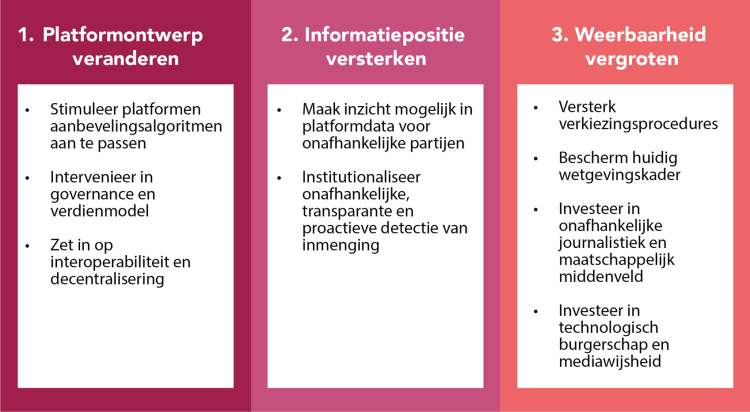

Om de risico's op inmengingsactiviteiten te verkleinen, geeft dit rapport handelingsperspectieven in drie richtingen: (1) platformontwerp veranderen, (2) informatiepositie versterken, (3) weerbaarheid vergroten. Een combinatie van deze handelingsperspectieven is wenselijk.

De eerste richting vraagt om aanpassingen aan aanbevelingsalgoritmen en om het inzetten op meer fundamentele veranderingen in het landschap van socialmediaplatformen. De tweede richting gaat over het versterken van de informatiepositie van toezichthouders, onderzoekers, journalisten, politici en beleidsmakers. De derde richting vraagt om blijvende bescherming van verkiezingsprocessen en huidige wetgeving en investeren in onafhankelijke onderzoekers en weerbare burgers.

De drie handelingsperspectieven:

- Platformontwerp veranderen

a. Stimuleer platformen om aanbevelingsalgoritmen aan te passen.

b. Intervenieer in governance en verdienmodel.

c. Zet in op decentralisering en interoperabiliteit.

- Informatiepositie versterken

a. Maak inzicht mogelijk in platformdata voor overheid, toezichthouders en onderzoekers.

b. Institutionaliseer onafhankelijke, transparante en proactieve detectie van inmenging.

- Weerbaarheid vergroten

a. Versterk verkiezingsprocedures.

b. Bescherm de huidige wetgeving en verhelder waar nodig.

c. Investeer in onafhankelijke journalistiek.

d. Investeer in technologisch burgerschap en mediawijsheid.

Meer over de handelingsperspectieven staat in het blokje 'handelingsperspectieven', hieronder.

Kwaadwillende buitenlandse statelijke actoren kunnen inspelen op aanbevelingsalgoritmen van sociale media door de zichtbaarheid van bepaalde inhoud te vergroten of te verkleinen. Er is sprake van inmenging wanneer deze actoren proberen de ontvanger bewust te misleiden over de inhoud en/of de populariteit daarvan. Doel is om uiteindelijk de publieke opinie of verkiezingen te beïnvloeden. Ze weten daarbij het socialmedialandschap te benutten.

Socialmediaplatformen zijn steeds sterker gaan leunen op engagement gebaseerde aanbevelingsalgoritmen, en hebben zo een online omgeving gecreëerd waar inhoud die inspeelt op emotie, misleiding en opruiing een groot bereik kan krijgen. Kwaadwillende buitenlandse actoren spelen hierop in door dit type inhoud te maken én te proberen om dit type inhoud een groter bereik te geven.

Technisch kunnen aanbevelingsalgoritmen anders worden ingesteld, maar fundamentele aanpassingen gaan in tegen het verdienmodel van platformbedrijven: platformen hebben baat bij op engagement gebaseerde aanbevelingsalgoritmen, omdat het de tijd die gebruikers doorbrengen op een platform vergroot. Het instrumentarium voor inmengingsactiviteiten zit zo dus feitelijk ingebouwd in de platformen.

Er is veel geregeld om het risico op inmenging via socialmediaplatformen te voorkomen of te bestrijden. De wetgever is zich duidelijk bewust van het probleem, en heeft verschillende instrumenten ontwikkeld om verschillende aspecten van inmenging aan te pakken. Ook platformen hebben regels opgesteld. Toch wijzen experts nog op de noodzaak voor aanvullende maatregelen en handhaving. Om risico te verkleinen, geven we handelingsperspectieven in drie richtingen: platformontwerp veranderen, informatiepositie versterken en weerbaarheid vergroten. (zie hierna bij 'handelingsperspectieven')

We structureren de handelingsperspectieven aan de hand van drie richtingen die uit ons literatuuronderzoek, interviews, expertsessie en analyse daarvan naar voren komen

De drie richtingen zijn:

- Platformontwerp veranderen.

- Informatiepositie versterken.

- Weerbaarheid vergroten.

In de figuur vatten we de handelingsperspectieven samen. Daarna lichten we ze toe.

1. Platformontwerp veranderen

Ontwerpkeuzes die platformen maken over de inrichting van hun aanbevelingsalgoritme, contentmoderatie en platform, hebben veel invloed op wat mensen online zien en kunnen verspreiden. Platformen maken die ontwerpkeuzes onder andere gebaseerd op hun visie, governance en verdienmodel (Rathenau Instituut, 2025a). De manier waarop aanbevelingsalgoritmen ontworpen zijn, biedt kwaadwillende actoren een instrumentarium om in te mengen in ons online publieke debat. Overheden kunnen daarom overwegen om platformen te stimuleren of verplichten hun platformontwerp aan te passen. Het coalitieakkoord 2026-2030 lijkt aan te sturen op aanpassingen, want hierin staat: 'Verslavende, polariserende en antidemocratische algoritmes worden verboden' (D66, VVD en CDA, 2026).

Bij de handelingsperspectieven maken we onderscheid in het ingrijpen in aanbevelingsalgoritmen en in het ingrijpen in governance en verdienmodellen.

1.a Stimuleer platformen om aanbevelingsalgoritmen aan te passen

Overheden en toezichthouders kunnen socialmediaplatformen bevragen op de maatregelen die zij nemen om de risico's die voortvloeien uit hun aanbevelingssystemen te beperken. De risico-rapportages die de grote platformen onder de DSA moeten maken, bieden daarvoor aanknopingspunten.

We hebben een tabel opgesteld van mogelijke interventies in aanbevelingsalgoritmen die platformen kunnen doen (zie het rapport, pagina 82, tabel 7). Sommige interventies kunnen al deels door platformen zijn doorgevoerd. Andere zijn alleen nog getoetst in wetenschappelijke experimenten of geopperd door experts.

De tabel laat zien dat er aan aanbevelingsalgoritmen nog erg veel te veranderen valt met mogelijke positieve effecten voor gebruikers, het publieke debat en het afnemen van het risico op inmenging in verkiezingen.

Het parlement kan platformen vragen om van al deze interventies aan te geven of ze de suggesties van experts hebben overwogen en getest en wat hun afwegingen zijn om de aanpassing niet door te voeren. Het aandringen op of verplichten tot aanpassingen om de zeggenschap van gebruikers te vergroten kan ook worden meegenomen in toekomstige wetgeving, zoals de Europese Digital Fairness Act waarvoor de onderhandelingen nu bezig zijn.

Bij ontwerpaanpassingen moet vaak een afweging worden gemaakt tussen voordelen en nadelen. Ook aanpassingen kunnen effect hebben op fundamentele rechten van gebruikers, of ze kunnen de economische belangen van platformen schaden (Lubin et al., 2024).

Neem bijvoorbeeld het beperken van de zichtbaarheid van nieuwe accounts. Dit kan effectief zijn om het moeilijker te maken om in aanloop naar verkiezingen met een netwerk van nepaccounts bewust te misleiden. Het nadeel hiervan is dat alle nieuwe accounts minder bereik krijgen.

Of neem het sturen op minder op engagement gebaseerde aanbevelingsalgoritmen waardoor hyperactieve accounts minder bereik krijgen, maar gebruikers ook minder tijd doorbrengen op socialmediaplatformen.

Daarom is het nodig effectiviteit en impact van maatregelen te kunnen monitoren, zodat die ook kunnen worden bijgestuurd. Socialmediaplatformen lenen zich gelukkig goed voor deze vorm van op onderzoek gestoelde regulering, omdat platformen in potentie goede manieren hebben om het effect van maatregelen te testen (Lubin et al., 2024).

Hoe onderstaande voorgestelde aanpassingen zouden uitwerken en of voordelen opwegen tegen eventuele negatieve bijeffecten, is onbekend. Onderzoekers kunnen momenteel namelijk niet meekijken bij platformen. Zie hier ook de wenselijkheid om de informatiepositie van onder andere onderzoekers ten opzichte van platformen te versterken.

1.b Intervenieer in governance en verdienmodel

De schaal waarop de huidige online platformen opereren is enorm. De eigenaarsstructuur en governance (hoe een online omgeving wordt bestuurd) van grote online platformen zorgt er dan ook voor dat de beslissingen van een kleine groep bedrijven en hun eigenaren grote invloed hebben op wat mensen wereldwijd online zien en kunnen delen (Rathenau Instituut, 2025a). Zij hebben macht over welke typen inhoud relatief versterkt wordt ten opzichte van andere inhoud, en hun ontwerpkeuzes scheppen mogelijkheden of beperkingen tot inmenging op hun platformen.

In de begindagen van het internet was de macht om online omgevingen in te richten anders verdeeld dan nu. In zijn boek The Modem World: A Prehistory of Social Media beschrijft Kevin Driscoll bijvoorbeeld hoe bulletinboardsystemen op een aantal manieren anders waren dan hoe we nu het internet gebruiken (Driscoll, 2022). Online omgevingen waren vaak lokaal, met veel invloed van de gemeenschap die ze gebruikten.

Inmiddels ontvangen grote platformbedrijven veruit het grootste deel van de advertentie-inkomsten waar ook journalistiek mee wordt gefinancierd. Hierdoor verschraalt het journalistieke aanbod (Digital News Report Nederland 2025, 2025, p. 40). Dat terwijl de democratie juist gebaat is bij een pluriforme en vrije informatievoorziening.

Een vergaande route is het ingrijpen op het advertentiegedreven verdienmodel van socialmediaplatformen. Dat verdienmodel is een belangrijke reden voor de opkomst van op engagement gebaseerde aanbevelingsalgoritmen. Hoe langer mensen op een platform blijven, hoe meer advertentie-inkomsten er worden verdiend. Ingrijpen in het verdienmodel heeft uiteraard ook nadelen, zoals een stijging van kosten die aan de gebruikers wordt doorgerekend. Toch zou deze afweging op tafel moeten liggen. De Digital Fairness Act biedt hiervoor aanknopingspunten.

1.c Zet in op decentralisering en interoperabiliteit

De overheid kan een pluriform en decentraal landschap van online omgevingen stimuleren. Bij decentrale omgevingen ligt de controle niet meer bij één partij, maar ligt deze in handen van verschillende (kleinere) partijen. Dit geeft meer controle en autonomie aan gebruikers. Het rapport Inclusief online (Rathenau Instituut, 2025a, p. 101) gaat dieper in op het stimuleren van alternatieven voor dominante socialmediaplatformen.

Alternatieve platformen geven geen garantie tegen inmenging. Een pluriform en decentraal landschap van online omgevingen versterkt echter wel de onderhandelingsruimte van de overheid ten opzichte van de huidige dominante platformen. Ook vergroten alternatieven de keuzevrijheid voor gebruikers. Bovendien verkleinen ze de impact van één of enkele platformen.

Socialmediaplatformen beheren nu het hele proces voor het verspreiden en zien van inhoud op hun platformen. Wat als meerdere partijen in dit proces betrokken kunnen zijn? Mensen zouden dan verschillende aanbevelingsalgoritmen van andere partijen kunnen kiezen. Of verschillende vormen van contentmoderatie. Wetenschappers noemen dit idee middlewares: het openbreken van socialmediaplatformen zodat verschillende partijen ook een rol kunnen spelen in de governance van platformen (Hogg & DiResta, 2024).

Door andere partijen ook aanbevelingsalgoritmen te laten aanbieden, zouden gebruikers van Instagram, TikTok of Snap bijvoorbeeld kunnen kiezen hun tijdlijn te laten cureren door een landelijke krant, hun lokale sportvereniging of een andere groep mensen die ze vertrouwen. Die kunnen dan hun eigen parameters bepalen: welk type inhoud krijgt bij ons voorrang?

Hetzelfde kan gelden voor contentmoderatie die nu gecentraliseerd door grote platformen wordt gedaan. Contentmoderatie kan ook meer door gemeenschappen zelf gedaan worden. Dat kan de legitimiteit en de kwaliteit van beslissingen over inhoud vergroten (Zuckerman, 2023). Het introduceren van middlewares zou ook nieuwe verdienmodellen kunnen opleveren voor partijen buiten de grote gecentraliseerde platformen.

Het verdient de aanbeveling om in Europees verband uit te zoeken hoe en of middlewares, kunnen zorgen voor betere bescherming tegen pogingen tot inmenging via social media. Verschillende organisaties, waaronder de economische denktank Bruegel, raden aan om interoperabiliteitseisen uit te breiden om burgers gemakkelijker te laten overstappen (Scott Morton, 2024).

2. Informatiepositie versterken

Uit ons onderzoek blijkt dat de informatiepositie van toezichthouders, onderzoekers, journalisten, politici en beleidsmakers ten aanzien van platformen te wensen over laat. Andere partijen dan platformen (zoals de overheid, de wetenschap of de journalistiek) kunnen onvoldoende onafhankelijk vaststellen of er sprake is geweest van inmenging tijdens de verkiezingen. Hoe meer kennis beschikbaar is voor externe deskundigen, hoe beter en tijdiger inmenging gedetecteerd kan worden. Dergelijk publiek toezicht is tenslotte ook essentieel omdat de kwalificatie van inmenging gemakkelijk misbruikt kan worden voor politieke doeleinden (zie hoofdstuk 2).

Binnen de richting 'informatiepositie versterken' geven we inzicht in het type informatie dat externe deskundigen van platformen nodig hebben om grip te krijgen op inmengingsactiviteiten en stellen we een onafhankelijk detectie-orgaan voor dat zelf ook proactief inmengingsactiviteiten kan aanpakken.

2.a Maak inzicht mogelijk in platformdata voor overheid, toezichthouders en onderzoekers

Meer inzicht in de wijze waarop inhoud in onze tijdlijn verschijnt, is nodig. Denk aan (precisering van) het contentmoderatiebeleid, de kwaliteitsscores die aan inhoud wordt gegeven, bedrijfsregels voor rangschikken van inhoud en de gewichten die platformen in hun aanbevelingsalgoritmen toepassen (zie hoofdstuk 3). Met behulp van dit type informatie kunnen externe partijen beter meekijken met de maatregelen die platformen daadwerkelijk nemen en in hoeverre deze effectief zijn. Hetzelfde geldt voor de inhoud die op platformen wordt geplaatst. Platformen spelen, samen met de afzenders, ook een rol in het transparant maken van dergelijke informatie. Verschillende maatregelen kunnen de informatiepositie van beleidsmakers, politici, toezichthouders, onderzoekers en journalisten verbeteren.

Volgens de DSA moeten platformen hun inhoud toegankelijk maken voor toezichthouders en onafhankelijke onderzoekers. De mate van toegang tot systemen verschilt, waarbij toezichthouders de grootste toegang krijgen. Experts geven aan dat de informatie die platformen tot nu toe delen nog te beperkt is om goed grip te krijgen op de uitwerking van aanbevelingsalgoritmen en inmengingsactiviteiten (zie hoofdstuk 5).

We doen hieronder voorstellen die de informatiepositie van derden zouden kunnen vergroten en die bijdragen aan de verwezenlijking van de doelen van verschillende bepalingen uit de DSA, zoals artikel 34, 35, 37 en 40.

Ook het coalitieakkoord kan aanknopingspunten geven om platformen te laten aantonen dat hun platformen niet bijdragen aan inmenging in verkiezingen, het verspreiden van misleidende content en het zaaien van twijfel over democratische processen.

Realtimesteekproeven

Inzicht in de rol en werking van aanbevelingsalgoritmen helpt om een goed beeld te krijgen van systeemrisico's. Dat kan door realtimesteekproeven te publiceren van openbare inhoud die het meest wordt verspreid en inhoud die het meeste engagement genereert. Inzicht kan ook worden vergroot door in realtime representatieve steekproeven te verrichten van de openbare inhoud die wordt geconsumeerd tijdens een typische gebruikerssessie op het platform op een willekeurig moment (Cooper & Chapman, 2025).

Verspreiding van inhoud

Inzicht in het aantal mensen en de typen groepen waarbij reeds verwijderde inhoud terecht is gekomen, kan helpen.

Ontwerp van aanbevelingsalgoritmen

Inzicht in de technische specificaties van de architectuur van de aanbevelingsalgoritmen (recommender systems) van platformen is belangrijk (Panoptykon et al., 2024). Denk aan:

- Wat is het type algoritme en wat zijn de hyperparameters? Wat is de grootte van een gebruikt neuraal netwerk?

- Wat is de inputdata en het relatieve belang van verschillende typen inputdata? Voor lineaire regressies: wat zijn de gewichten?

- Hoe wordt de inputdata gepresenteerd en wat is de logica achter gebruikte embedding spaces?

- Wat is de loss function van gebruikte modellen?

- Wordt trainingsdata door mensen gelabeld? Welke partijen zijn op welke manier betrokken in dit proces van labelen?

- Welke inspanningen worden geleverd om voor mensen begrijpelijke machinelearningsystemen te bouwen? Wat zijn de resultaten van de ontwikkelde algoritmische-interpretatietools?

Daarnaast is het voor een goed begrip van de precieze werking van aanbevelingsalgoritmen van specifieke platformen nodig om inzicht te hebben in de 'afweging' die platformen maken in het ontwerp van hun aanbevelingsalgoritmen, inclusief de data zij als input gebruiken en de gewichten die zij toekennen bij hun aanbevelingssystemen (KGI Expert Working Group on Recommender Systems, 2025). Ook inzicht in de maatstaven die platformen gebruiken om het ontwerp van hun aanbevelingssystemen te evalueren zou behulpzaam zijn (KGI Expert Working Group on Recommender Systems, 2025).

Resultaten van interne A/B-testen van platformen

Inzicht in de effecten van (constante) wijzigingen aan het ontwerp van aanbevelingssystemen kan verkregen worden door A/B-testen. Veel platformen gebruiken voor A/B-testen een holdout-groep, een controlegroep van gebruikers die niet wordt blootgesteld aan de wijzigingen. Langdurige holdout-experimenten geven veel inzicht in het effect van ontwerpkeuzes op gebruikers en zouden op geaggregeerde wijze gepubliceerd kunnen worden. Een verplichting hiertoe zou platformen ook kunnen prikkelen om hun ontwerp beter aan te laten sluiten op behoeften van gebruikers (Cooper & Chapman, 2025).

Inspanningen rond verkiezingstijd

Inzicht in toegankelijke informatie over platforminspanningen rondom verkiezingstijd, bijvoorbeeld via pre- en postelectorale evaluatie, kan helpen bij het versterken van de informatiepositie.

Standaardisatie van toegang en rapportages

Het is tenslotte van belang om in te zetten op standaardisatie voor toegang voor onderzoekers en toezichthouders alsook standaardisatie van identificatie, mitigatie en rapportage van systeemrisico's. Effectieve risicobeperking vereist transparante meetcriteria en evaluatiemethoden, ondersteund met datagedreven onderbouwing die het mogelijk maken om de risico's en effectiviteit van maatregelen in de loop der tijd voor buitenstaanders te beoordelen. Toezichthouders kunnen de zeer grote platformen en zoekmachines volgens de DSA aanspreken op de kwaliteit van risicoanalyses en inzetten op een lerende praktijk.

2.b Institutionaliseer onafhankelijke, transparante en proactieve detectie van inmenging

Inmenging vraagt om meer institutionele inbedding van detectie en bestrijding van inmengingsactiviteiten. Voor het melden van inhoud die de verkiezingen zouden kunnen schaden heeft de overheid een verkiezingsflaggerstatus. Maar er is ook behoefte aan meer zicht op inmengingsactiviteiten op sociale media vanuit de overheid. Van belang is daarbij dat er duidelijke waarborgen zijn tegen politieke invloed en censuur.

Hiervoor geven we twee handelingsopties mee. De eerste suggestie is dat de overheid meer signaleringsmogelijkheden zou kunnen krijgen. De overheid heeft verkiezingsflaggerstatus bij de grote platformen (zie hoofdstuk 2), die ze bewust terughoudend inzet. Maar het signaleren van content mag alleen op aanbeveling van derden, niet op basis van eigen onderzoek. Het valt te overwegen de overheid ook meer mogelijkheden te geven om proactief inhoud te signaleren die de verkiezingen ondermijnt. Het is zaak de juiste balans te vinden tussen het verruimen van handelingsmogelijkheden én het bewaken van de vrijheid van meningsuiting. Dat is in lijn met ons Bericht aan het parlement Desinformatie bestrijden, censuur vermijden (Rathenau Instituut, 2020).

De tweede suggestie is dat er ingezet kan worden op de ontwikkeling van een onafhankelijk orgaan dat inmenging kan signaleren. Laat het orgaan nauw samenwerken met onafhankelijke experts zoals desinformatie-experts, platformonderzoekers, computerwetenschappers, cybersecurity-experts en juristen. Ten tijde van schrijven van dit rapport loopt bij het Ministerie van Binnenlandse Zaken en Koninkrijksrelaties een verkenning voor de oprichting van een desinformatiedetectieorgaan. Dat zou hierin kunnen voorzien.

Inmengende actoren zijn inventief. Inmengingsactiviteiten zijn altijd in beweging en springen in op nieuwe ontwikkelingen, zoals de opkomst van chatbots, personalisatie van nieuws en microbetalingen aan influencers via nauwelijks te modereren livestreams. Er is dus blijvend onderzoek en monitoring nodig.

Voor de monitoring en detectie van inmengingsactiviteiten op socialmediaplatformen wordt sterk geleund op wetenschappers en ngo's. Het valt te overwegen dit soort partijen structureel te financieren om dit onderzoek systematisch uit te voeren.

3. Weerbaarheid vergroten

De handelingsperspectieven hierboven zijn enerzijds gericht op platformen en anderzijds op het verbeteren van de informatiepositie over inmenging via platformen. Deze handelingsperspectieven zijn sterk afhankelijk van handhaving en de medewerking van socialmediabedrijven. Het is in de context van inmenging via platformen ook zinvol te kijken naar interventies die niet afhankelijk zijn van socialmediaplatformen en die de weerbaarheid van de samenleving als geheel vergroten.

Hieronder gaan we in op verschillende manieren om de samenleving weerbaarder te maken tegen inmengingsactiviteiten.

3.a Versterk verkiezingsprocedures

Inmengingspogingen kunnen leiden tot onenigheden over de verkiezingsuitslag. Dat maakt het belang van beoordeling over het eerlijk verloop van verkiezingen, die niet kwetsbaar zijn voor politieke invloed, essentieel.

Neem daarom maatregelen om de onafhankelijkheid bij besluiten over verkiezingsgeschillen te versterken. Zorg ervoor dat er duidelijke criteria zijn voor het overgaan tot hertelling en herstemming. Onderzoek of de termijn voor het vaststellen van onregelmatigheden tijdens verkiezingen kan worden verruimd aangezien inmenging via social media tijd kost om te bewijzen. Evalueer systematisch in hoeverre verkiezingsprocedures adequaat zijn toegerust op inmengingsactiviteiten en stel deze zo nodig bij.

3.b Bescherm de huidige wetgeving en verhelder waar nodig

Heldere normstelling, consistente toepassing van bestaande wetgeving en effectief toezicht zijn nodig om inmengingsactiviteiten het hoofd te bieden.

Opvallend is dat AI-systemen die worden gebruikt voor het beïnvloeden van de uitslag van een verkiezing, referendum of stemgedrag niet verboden zijn, maar in de hoog-risico-categorie vallen. Het is momenteel niet duidelijk wat precies wordt bedoeld met AI-systemen. Zorg ervoor dat toezichthouders voldoende capaciteit hebben om te verduidelijken welke AI-systemen onder de categorie verboden en onder de categorie hoog risico van de AI-verordening vallen. Ook kan uitgezocht worden in hoeverre dergelijke systemen verenigbaar zijn met de AVG en VPR.

Ondersteun onderzoekers en maatschappelijke organisaties en toezichthouders met voorbeelden en casestudy's, bijvoorbeeld over de wijze waarop AI-systemen stemgedrag kunnen beïnvloeden en maatschappelijke schade kunnen aanrichten, ter ondersteuning van de richtlijnen die nu worden opgesteld. Ontwikkel en test templates voor risicobeoordelingen van het gebruik van AI bij verkiezingen.

Stuur daarnaast aan op, of onderzoek de mogelijkheden voor, een moratorium op het gebruik van AI-systemen in verkiezingscampagnes om een beter inzicht te krijgen in de maatschappelijke en politieke impact en onderzoek.

Versterk ook het toezicht op de AI-verordening, DSA, AVG en VPR met het oog op inmenging. Zet in op snelle uitvoerbaarheid van de VPR in Nederland en zorg er ook voor dat platformen zich houden aan eigen community guidelines omtrent betaalde politieke inhoud. Zoek daarbij samenwerking op met andere Europese toezichthouders.

3.c Investeer in onafhankelijke journalistiek

Investeer in een pluriform medialandschap, inclusief een publieke omroep, om verschraling van de onafhankelijke informatievoorziening tegen te gaan. Onafhankelijke journalistiek vervult een signaalfunctie in de samenleving en is een van de controlerende machten in een democratie. Journalistiek en onderzoek functioneren onafhankelijk van overheid en bedrijfsleven en kunnen misstanden in de samenleving aankaarten. Onafhankelijk onderzoek vervult hiermee een belangrijke rol in het informatie-ecosysteem.

3.d Investeer in technologisch burgerschap en mediawijsheid

De DSA heeft de positie van de gebruikers ten opzichte van grote socialmediaplatformen verbeterd. Het is echter de vraag of gebruikers hiervan op de hoogte zijn. Digitale rechten gaan onder andere over toegankelijkheid voor gebruikers om melding te maken van inhoud die in strijd is met platformregels. En ook over het recht om te weten wat er met een melding gebeurt. De overheid zou bewustwording bij burgers over hun digitale rechten kunnen bevorderen.

Als gebruikers van socialmediaplatformen zich realiseren wat de mogelijkheden voor inmenging zijn, zou het kunnen dat inmenging minder effectief wordt. Mensen herkennen mogelijk de inmengingsactiviteiten. Waarschuwingen voor inmenging kunnen er echter ook toe leiden dat mensen alle informatie gaan wantrouwen of dat mensen minder vertrouwen krijgen over de eerlijkheid van verkiezingen (Altay et al., 2025).

Onderwijs over hoe een open democratie werkt, kan helpen de democratie te versterken. Hoe wordt er in Nederland gezorgd dat verkiezingen eerlijk verlopen? Welke waarborgen kennen journalistieke redacties? En waar is juiste informatie over verkiezingen? En hoe komen burgers tot politieke oordeelsvorming? Deze vragen kunnen onderwerpen van gesprek leveren waarbij de werking van een democratische samenleving centraal staat. Daarmee kunnen ze de weerbaarheid tegen inmengingsactiviteiten vergroten.